¿Listo para cuestionarte todo?

📅 Esta semana:

En El Chip Maestro, nos asomamos al algoritmo de X y a cómo decide qué merece tu atención; ¿eliges tú o solo reaccionas? Mientras, en La Butaca del Caos, Fifteen Million Merits nos recuerda que la atención siempre tiene precio…

Pero antes, repasemos las noticias más relevantes de la semana…

📰 FLASH NEWS

👀 Apple y OpenAI vuelven a intentar matar la pantalla

Apple y OpenAI apuestan de nuevo por wearables con mucha IA y cero pantallas, pese a que intentos recientes como Humane AI Pin o Rabbit R1 acabaron en fracaso. La promesa es clara: interacción por voz y computación “ambiental” para reducir la dependencia del móvil.

Apple prepara un dispositivo sin pantalla, con cámaras y micrófonos, previsto para 2027, mientras OpenAI trabaja en unos auriculares con IA propios junto a Jony Ive. En un mundo dominado por TikTok y el vídeo constante, la pregunta es inevitable: ¿la IA ya está lista para quitarnos la pantalla… o volverá a tropezar con la misma piedra?

📢 ChatGPT gratis empieza a pagar peaje

OpenAI ya está probando anuncios en ChatGPT para usuarios gratuitos en Estados Unidos, dejando claro que la era de la IA “mágica y gratis” toca a su fin. Los planes Plus, Pro y Enterprise se libran… por ahora.

La excusa es la AGI, pero el mensaje real es monetización: solo un 5 % de sus 1.800 millones de usuarios paga, y la publicidad es el empujón clásico hacia la suscripción, como ya pasó con Netflix, YouTube o Spotify. ¿Pagaremos para huir de los anuncios o empezaremos a buscar alternativas fuera de la nube?

🧒 ChatGPT empezará a “adivinar” tu edad

OpenAI va a implementar un sistema de predicción de edad en ChatGPT para adaptar las respuestas si detecta que el usuario es menor. Analizará temas de conversación y horarios de uso para activar automáticamente filtros que limiten contenido sensible.

Si el sistema se equivoca, podrás verificar tu edad con un servicio externo llamado Persona, incluso con selfie o documento oficial. La idea es proteger a los menores, pero la pregunta es incómoda: ¿más seguridad… o más vigilancia encubierta?

🎭 YouTube deja que tu clon publique por ti

YouTube permitirá crear Shorts usando una versión con IA del propio creador: un clon fotorrealista generado a partir de su rostro y su voz. El anuncio lo hizo su CEO, Neal Mohan, marcando un nuevo paso en la automatización total del contenido.

La promesa es multiplicarte sin grabar: más vídeos, menos esfuerzo, y presencia constante incluso cuando no estás. Pero el dilema es evidente: si tu cara y tu voz ya pueden producir contenido solas… ¿dónde acaba el creador y empieza la máquina?

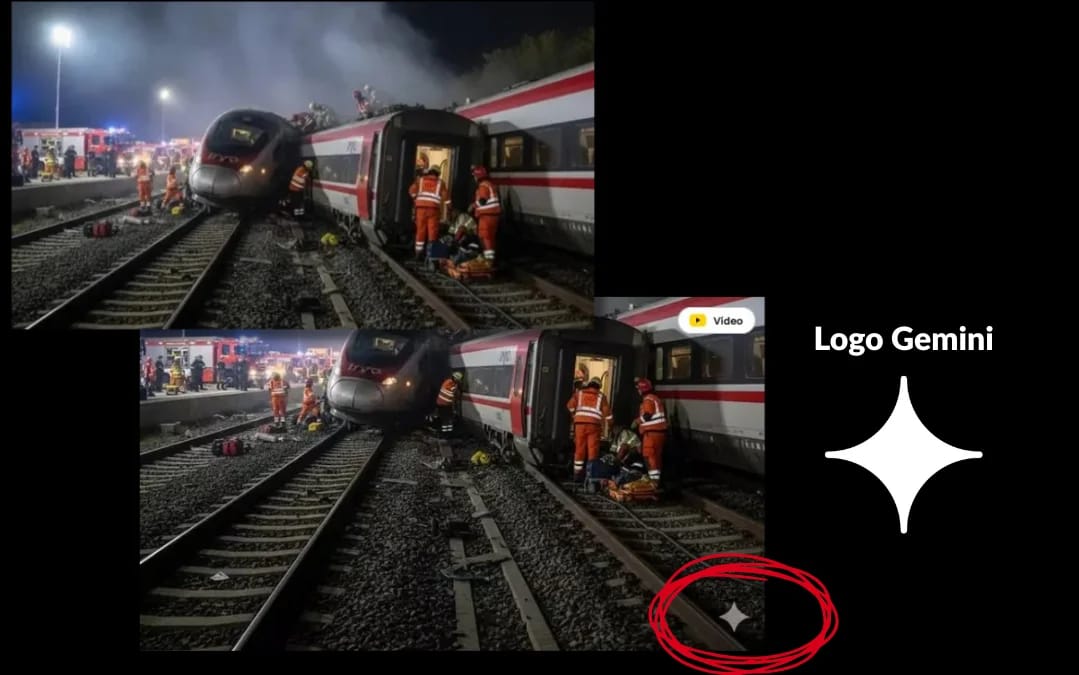

La foto que circuló en redes sobre el descarrilamiento de trenes en Adamuz no es real: fue generada con inteligencia artificial y lleva la marca de agua de Gemini, la IA de Google. Además, contiene errores claros, como mostrar dos trenes Iryo chocando entre sí, algo que no ocurrió.

La imagen llegó a publicarse incluso en medios, y Cadena SER tuvo que pedir disculpas tras retirarla por falta de verificación. Un ejemplo más de cómo la IA ya no solo crea contenido… también confunde a periodistas y lectores.

🔓 Elon Musk libera el algoritmo de X

Elon Musk ha publicado en código abierto el algoritmo de recomendación de X, permitiendo que cualquiera pueda revisar cómo se decide qué contenido ves en tu feed y qué publicaciones se vuelven virales.

El código ya está disponible en GitHub y deja ver las reglas generales del sistema, en un momento en el que X compite con plataformas como Threads y recibe críticas por falta de transparencia. ¿Qué hay realmente detrás de lo que ves cada día en redes sociales? Sigue leyendo porque en El Chip Maestro entramos justo ahí…

⚠️ Antes de continuar…

Para seguir creando contenido independiente y gratuito, a veces colaboramos con marcas que de verdad creemos que te pueden aportar valor. Te dejamos la de esta semana:

(Si te interesa, cada click cuenta y nos ayuda 😉)

Help us make better ads

Did you recently see an ad for beehiiv in a newsletter? We’re running a short brand lift survey to understand what’s actually breaking through (and what’s not).

It takes about 20 seconds, the questions are super easy, and your feedback directly helps us improve how we show up in the newsletters you read and love.

If you’ve got a few moments, we’d really appreciate your insight.

🤖 EL CHIP MAESTRO

Tiempo de lectura: 2 minutos y 30 segundos

🧠 El algoritmo de X por dentro: ¿cómo piensan la redes sociales que deciden tu feed?

Pasamos horas en redes sociales sin pensar demasiado en por qué vemos lo que vemos.

Deslizamos, reaccionamos, nos enganchamos… Y seguimos.

No es casualidad.

Esta semana, X liberó parte de su algoritmo.

No el “secreto completo” pero sí lo suficiente como para asomarnos a cómo piensa el sistema que decide qué aparece en tu feed.

Hemos revisado ese código para intentar entender qué hay detrás de una red social que consigue retenernos durante horas.

Y lo que se ve desde dentro no habla de likes, ni de tendencias, ni de calidad.

Habla de comportamiento.

De atención.

De cuánto tiempo eres capaz de quedarte mirando.

Porque lo que decide lo que ves no es una persona.

Es una máquina entrenada para aprender qué te retiene…

Y repetirlo.

🧠 No decide qué es bueno. Decide qué harás tú.

Aquí es donde se caen la mayoría de mitos.

El algoritmo de X no evalúa si un contenido es bueno, verdadero o importante.

Evalúa qué cree que tú vas a hacer con él.

No juzga ideas como lo haría una persona.

No interpreta intenciones.

📌 Usa el contexto solo como materia prima para predecir reacciones y comportamientos.

Cada post se convierte internamente en una especie de apuesta:

“Si le enseño esto a esta persona… ¿Qué es más probable que haga?”

Y para responder a eso lo descompone en señales.

Señales como estas:

💬 ¿Responderás o pasarás de largo?

🔁 ¿Lo compartirás con alguien o lo guardarás?

👀 ¿Te quedarás leyendo unos segundos más?

➕ ¿Te dará motivos para seguir al autor?

❌ ¿Pensarás “no me interesa”, lo silenciarás o lo reportarás?

Cada una de esas reacciones tiene peso.

Algunas suman.

Otras restan.

Y algunas hacen que el contenido desaparezca.

Por eso el feed no refleja lo que es popular, sino lo que el sistema cree que te va a retener mejor a ti.

🤖 Qué le muestra X a una IA para decidir tu feed

En el código que X ha liberado, el feed no se decide de una sola vez ni con una única regla.

Se construye paso a paso.

Primero se juntan muchos posts candidatos.

Luego se eliminan los que no encajan.

Y solo después se calcula una puntuación para decidir cuáles compiten de verdad por aparecer.

La parte clave es que esa puntuación no se basa en opiniones ni en “calidad”.

Se basa en probabilidades de comportamiento.

Según el código, para cada post el sistema obtiene estimaciones como estas:

💬 Probabilidad de que respondas

🔁 Probabilidad de que compartas (por DM o copiando enlace)

👀 Tiempo estimado de lectura o visualización

➕ Probabilidad de que sigas al autor

❌ Probabilidad de rechazo: “no me interesa”, silenciar, bloquear o reportar

Estas probabilidades se convierten en números.

Con ellos, el sistema calcula una nota interna para cada post, combinando todas las señales con pesos (los pesos existen pero sus valores exactos no son públicos).

Después, esa nota se ajusta:

👤 Si aparecen muchos posts del mismo autor, los siguientes pierden fuerza.

🌐 Si el post es de alguien a quien no sigues, se ajusta su puntuación.

Y antes incluso de puntuar, hay filtros que eliminan contenido directamente:

⏱️ Posts demasiado antiguos no compiten.

👀 Posts que ya has visto desaparecen.

🔇 Posts que coinciden con palabras que sueles silenciar se descartan.

El resultado es que lo que llega a tu feed no es “el mejor contenido”, sino el que mejor encaja con tu patrón de atención en ese momento.

Normalmente, además, un solo punto de entrada por conversación o hilo.

No porque sea el más importante, sino porque es el más eficiente para mantenerte dentro.

🔍 Lo que curiosamente no han liberado

Aquí viene la parte incómoda.

X habla de transparencia…

Pero lo que ha liberado es la carcasa, no el motor.

Sí, podemos ver cómo se estructura el sistema.

Pero lo verdaderamente decisivo sigue cerrado.

⚠️ Lo que NO se ha liberado:

🔹 Los pesos exactos de cada señal. Sabemos qué comportamientos se tienen en cuenta, pero no cuánto vale cada uno.

🔹 Las reglas finales de decisión. El momento exacto en el que el sistema dice “esto entra” o “esto no”.

🔹 Los parámetros que realmente inclinan la balanza. Los ajustes finos que determinan qué tipo de contenido gana en igualdad de condiciones.

🔹 El comportamiento real del modelo de predicción. Vemos que existe, pero no cómo ha sido entrenado ni con qué datos.

🔹 Los sesgos aprendidos. No sabemos si el sistema tiende a favorecer conflicto, polarización, repetición o determinados patrones de reacción.

Es como enseñarte el tablero.

Pero no decirte cuánto vale cada pieza.

Ni quién decide las reglas de la partida.

🚨 Y eso no es casual.

Porque ahí es donde reside el verdadero poder del sistema: en decidir qué comportamiento merece más atención que otro.

No qué es verdad.

No qué es valioso.

Sino qué retiene mejor.

Cuando no ves los pesos, no sabes si el sistema:

🔹 Premia conversación… o conflicto,

🔹 Fomenta diversidad… o repetición,

🔹 Prioriza información… o fricción.

No porque haya una intención ideológica clara, sino porque optimizar atención siempre introduce sesgos, aunque no se declaren.

Y esos sesgos no están en el código visible.

Están en lo que no se ha liberado.

Este punto lo explica casi todo.

Del código liberado no se pueden extraer valores editoriales, ni criterios explícitos sobre verdad, calidad o intención informativa.

Lo que sí se ve con claridad es otra cosa.

📌 Un sistema optimizado para medir y maximizar atención.

Como cualquier empresa basada en publicidad y datos, X compite por un recurso limitado:

⏱️ Tu tiempo

🧠 Tu atención

💬 Tu interacción

Todo el sistema está optimizado para eso.

Si un contenido te hace quedarte, reaccionar o discutir… gana.

Si no… desaparece.

No porque sea malo.

Sino porque no cumple su función económica y empresarial.

Por lo tanto, el algoritmo no te manipula: optimiza

Esto es importante decirlo así.

No hay una mente malvada detrás.

Hay optimización fría.

Por eso ves patrones.

Por eso ciertos formatos vuelven una y otra vez.

Por eso algunas dinámicas se amplifican.

👀 Qué implica esto para ti como usuario

Entender esto cambia la perspectiva.

No ves “lo mejor”.

Ves lo que más probable es que te enganche.

No porque lo elijas conscientemente, sino porque el sistema ha aprendido cómo reaccionas.

📌 Saberlo no te saca del juego.

Pero te permite jugar con más conciencia.

Porque cuando sabes que todo gira en torno a la atención, empiezas a preguntarte cosas distintas:

💬 ¿Por qué este contenido me ha retenido?

📢 ¿Qué tipo de estímulos consumo sin darme cuenta?

⚠️ ¿Quién decide realmente lo que veo cada día?

El algoritmo no manda.

Mandan tus hábitos de consumo…

¿O esos hábitos ya están moldeados, en parte, por los propios algoritmos?

🍿 LA BUTACA DEL CAOS

Fifteen Million Merits (T 1, E 2 – Black Mirror, 2011)

Crees que eliges lo que ves. Pero quizás solo eres otro reflejo atrapado en un espejo diseñado para devolverte justo lo que más te atrapa. Black Mirror lo advirtió: no vivimos en una distopía... vivimos en un escaparate personalizado. Uno que se actualiza cada vez que pestañeas.

📖 Trama:

En esta pesadilla futurista, los humanos pedalean día y noche, generando energía y acumulando “méritos” para comprar comida, saltarse anuncios o, con suerte, tener un minuto de autenticidad. Bing, nuestro Hamlet digital, arriesga su fortuna para que Abi, una joven de voz angelical, participe en un concurso de talentos. Lo que él cree un acto de liberación, el sistema lo digiere, lo mastica… y lo transforma en entretenimiento rentable. ¿Revolución? Solo si trae clics.

👥 Personajes:

Bing es el mártir del algoritmo: atrapado en la ilusión de que su grito puede cambiar algo. Pero el sistema no escucha… calcula. Abi, por su parte, representa la pureza sacrificada en un altar de pantallas y juicios prefabricados. No la valoran por su arte, sino por su capacidad de retención. Y el jurado, esos profetas del cinismo, son simplemente filtros humanos optimizados para extraer atención y convertirla en consumo.

🖋️ Estilo y narrativa:

El episodio construye un mundo sin sombras, donde la luz blanca lo ilumina todo… salvo la verdad. La dirección nos obliga a observar como rehenes, mientras cada decisión, cada impulso, es registrado, evaluado, y convertido en señal. Igual que en tu feed diario, donde no importa si un contenido es cierto o falso, solo si te detiene… un segundo más que el anterior.

🧠 Conclusión:

Lo inquietante no es que el sistema te muestre lo que quiere. Es que te conoce tan bien, que ya no necesita forzarte. Solo hace cálculos, predicciones, ajustes invisibles. Como en Fifteen Million Merits, no ves lo que es valioso: ves lo que predijeron que no podrías ignorar.

Y mientras sigas creyendo que tienes el control, seguirás pedaleando. Feliz, entretenido… y perfectamente predecible.

🎭 Así que dime…

¿Estás mirando la pantalla, o la pantalla te está mirando a ti?