¿Listo para cuestionarte todo?

📅 Esta semana:

En El Chip Maestro exploramos el nacimiento de la guerra algorítmica: modelos de IA que ya analizan inteligencia militar y priorizan objetivos. En La Butaca del Caos regresamos a Dr. Strangelove, donde sistemas diseñados para protegernos terminan acercándonos al desastre.

Pero antes, repasemos las noticias más relevantes de la semana…

📰 FLASH NEWS

🤖 OpenAI lanza GPT-5.4, ya puede usar tu ordenador

OpenAI, dirigida por Sam Altman, ha lanzado GPT-5.4, su IA más avanzada y la primera con capacidad nativa para controlar un ordenador y automatizar tareas. El modelo mejora en análisis de datos, creación de documentos y fiabilidad, con un 33% menos de afirmaciones falsas que la versión anterior.

También incorpora una ventana de hasta 1 millón de tokens (en API y Codex) para trabajar con documentos largos y permite interrumpir su razonamiento en tiempo real. Ya está disponible en los planes Plus, Pro y Team de ChatGPT, aunque en la API llega con precios más altos que GPT-5.2. Si la IA ya puede usar tu ordenador… ¿cuánto falta para que también haga tu trabajo?

⚔️ Pentágono rompe con Anthropic… y OpenAI ocupa su lugar

El Departamento de Defensa de EE. UU., liderado por Pete Hegseth, expulsó a Anthropic de sus contratos tras negarse a permitir que su IA se use para vigilancia masiva de ciudadanos o armas totalmente autónomas. Horas después, Sam Altman cerró un acuerdo entre OpenAI y el Pentágono, desatando críticas por supuestamente aceptar condiciones mucho más flexibles.

La reacción fue inmediata: las desinstalaciones de ChatGPT subieron 295% en un día, mientras Claude se disparó al nº1 de la App Store en varios países. La narrativa que circula: una empresa puso límites éticos y perdió el contrato; la otra mantuvo el negocio. Te explicamos este caso más detalladamente en el Chip Maestro.

⚡ Google lanza Gemini 3.1 Flash-Lite: IA más rápida y 50% más barata

Google presentó Gemini 3.1 Flash-Lite, su modelo de IA más rápido y económico hasta ahora. Diseñado para desarrolladores, promete respuestas hasta 2,5 veces más rápidas que versiones anteriores y la capacidad de manejar grandes volúmenes de datos sin disparar los costes.

El precio también baja fuerte: 0,25$ por millón de tokens de entrada y 1,50$ de salida, justo la mitad que su predecesor. Estará disponible en vista previa vía API en Google AI Studio y Vertex AI, compitiendo con modelos como GPT-5 mini o Claude 4.5 Haiku. La jugada es clara: hacer la IA tan barata y rápida que nadie tenga excusa para no usarla.

🎬 LTX 2.3: el primer estudio de video con IA que corre en tu portátil

La startup Lightricks lanzó LTX Studio 2.3 y su nueva app Desktop: un modelo de generación de video con audio incluido que funciona localmente en tu ordenador. Puede generar clips de hasta 4K a 50 FPS y 20 segundos, compatible con GPUs NVIDIA RTX 30/40/50 y hasta laptops con 8 GB de VRAM, sin depender del cloud.

La promesa: producción de video estilo Hollywood sin enviar tus datos a servidores externos ni pagar GPUs en la nube. El modelo además permite fine-tuning local y es gratuito para empresas con menos de 10M$ de ingresos. Si la IA creativa empieza a correr directamente en tu portátil… ¿se acabó el monopolio del cloud en la creación de contenido?

👓 Los vídeos de las Ray-Ban Meta los revisan humanos (en Kenia)

Una investigación del diario sueco Svenska Dagbladet revela que vídeos grabados con las gafas inteligentes Ray-Ban Meta Smart Glasses pueden ser revisados por operadores humanos en Kenia para entrenar la IA. Trabajadores subcontratados analizan escenas para etiquetar objetos, personas o situaciones y mejorar el sistema visual de Meta.

El problema: esos revisores aseguran que ven de todo, desde escenas domésticas hasta contenido íntimo o datos sensibles captados por las cámaras. Aunque la empresa afirma que esto ocurre solo cuando los usuarios comparten material con Meta AI, el caso vuelve a encender el debate: si llevamos cámaras con IA encima todo el día… ¿quién más termina viendo lo que grabamos?

⚠️ Antes de continuar…

Para seguir creando contenido independiente y gratuito, a veces colaboramos con marcas que de verdad creemos que te pueden aportar valor. Te dejamos la de esta semana:

(Si te interesa, cada click cuenta y nos ayuda 😉)

A comprehensive guide for addressing the tax talent crisis

A labor shortage in tax is driving the need for a new skill set: one that blends technical tax knowledge with digital fluency.

Automation, AI and data-driven insights now define the role of tax professionals.

This new era of tax is not simply about adopting new tools, it’s about reshaping the skill set and mindset required to thrive in this field. Check out this guide for actionable insights into how to cultivate these skills with your team. See how advanced technologies can help bridge the tax tech gap to increase efficiency, ensure compliance, and drive better decision-making.

🤖 EL CHIP MAESTRO

Tiempo de lectura: 3 minutos

🤖 La primera guerra con IA generativa: Claude, el Pentágono y la nueva era militar

Durante estos años hemos estado pensando que la inteligencia artificial serviría para escribir textos, generar imágenes o ayudar a programar.

Pero en 2026 está ocurriendo algo distinto.

Por primera vez, un modelo de IA generativa participó en operaciones militares reales.

No pilotaba drones.

No disparaba misiles.

Pero sí ayudó a analizar inteligencia, priorizar objetivos y acelerar decisiones militares a una velocidad nunca vista.

El sistema en cuestión es Claude, la IA de la empresa Anthropic.

Según varias investigaciones periodísticas, Claude se integró dentro de uno de los sistemas de inteligencia militar más avanzados de Estados Unidos.

Primero apareció relacionado con una operación que terminó con la captura de Nicolás Maduro.

Después, en un contexto mucho más delicado: ataques contra Irán.

Y justo cuando esto empezó a hacerse público, estalló un conflicto enorme.

⚔️ Anthropic se negó a aceptar ciertas condiciones del Pentágono.

🤝 OpenAI aceptó el acuerdo que ellos rechazaron.

Detrás de este conflicto hay algo mucho más profundo que una pelea entre empresas tecnológicas.

Estamos viendo el nacimiento de la guerra algorítmica.

Ahora la pregunta que nos hacemos es: ¿qué papel real está jugando la IA en todo esto?

🧠 Cómo una IA terminó dentro del sistema militar

Para entender la historia hay que empezar por un sistema llamado Maven.

El Proyecto Maven nació con una idea muy sencilla: ayudar al ejército a procesar enormes cantidades de información.

Porque en una guerra moderna los datos llegan de todas partes:

🛰️ satélites

📡 sensores militares

🛩️ drones de vigilancia

📄 informes de inteligencia

🌍 fuentes abiertas

El problema no es obtener información.

El problema es entenderla a tiempo.

Con el tiempo, Maven evolucionó hacia algo más complejo: Maven Smart System (MSS).

Este sistema conecta sensores, algoritmos y analistas humanos en una misma plataforma para ayudar a tomar decisiones más rápido.

Y es aquí donde aparece Claude.

La IA se integró dentro del sistema a través de la plataforma Palantir AIP, funcionando sobre infraestructura de AWS en entornos clasificados de seguridad (IL6).

En otras palabras:

Claude no era un chatbot militar.

Era más bien un copiloto analítico.

Su función era ayudar a:

resumir información

correlacionar datos

detectar patrones

priorizar posibles objetivos

Pero, y esto es importante, la decisión final seguía siendo humana.

Este modelo se conoce como:

💡 human-in-the-loop.

La IA ayuda, pero el comandante decide.

🕵️ La operación en Venezuela: lo que sabemos (y lo que no)

El primer episodio polémico aparece en enero de 2026.

Ese mes, una operación estadounidense terminó con la captura de Nicolás Maduro.

Poco después, Reuters informó que el Wall Street Journal había publicado algo sorprendente: que Claude se utilizó durante esa operación a través de la integración con Palantir.

Pero aquí viene el matiz importante.

Reuters también aclaró que no pudo verificar el dato de forma independiente.

Esto significa que la situación es la siguiente:

📌 El uso de Claude en esa operación es plausible pero no confirmado oficialmente.

Y tampoco existen documentos públicos que expliquen exactamente qué hizo la IA.

No hay:

informes operativos publicados

logs del sistema

diagramas técnicos de la misión

Por eso el propio análisis clasifica este caso con confianza media.

La hipótesis más razonable, basada en cómo funciona el sistema, es que la IA se utilizara para análisis y síntesis de inteligencia, no para dirigir la operación.

🚀 Irán: cuando la IA entra en la cadena de ataque

El segundo episodio es mucho más claro.

A finales de febrero de 2026, Estados Unidos e Israel iniciaron ataques contra objetivos iraníes dentro de una operación conocida como Epic Fury.

Aquí aparece la evidencia más concreta.

Según una investigación del Washington Post, el sistema Maven con Claude integrado habría ayudado a analizar enormes cantidades de inteligencia militar.

Las fuentes citadas describen que el sistema pudo:

🎯 sugerir cientos de posibles objetivos

📍 generar coordenadas

📊 priorizar objetivos según su importancia

📉 ayudar a evaluar resultados después de los ataques

Todo a partir de datos clasificados procedentes de satélites, vigilancia y otras fuentes de inteligencia.

Esto no significa que la IA decidiera atacar.

Pero sí significa algo nuevo:

💡 La IA participaba directamente en el análisis que precede a un ataque militar.

⚙️ La “kill chain”: dónde entra realmente la IA

En el ámbito militar existe un concepto llamado kill chain.

Es la secuencia de decisiones que lleva desde detectar un objetivo hasta ejecutar un ataque.

Simplificada, funciona así:

1️⃣ detectar señales

2️⃣ identificar objetivos

3️⃣ decidir qué hacer

4️⃣ ejecutar el ataque

5️⃣ evaluar resultados

Lo que muestran las investigaciones es que la IA generativa empieza a entrar en las primeras fases.

Especialmente en:

🔎 análisis de datos

🎯 identificación de objetivos

📊 priorización de escenarios

Pero no hay evidencia pública de que Claude controle armas o sistemas de ataque.

El papel de la IA es acelerar el análisis, no ejecutar el ataque.

Y ese detalle cambia mucho cómo entendemos el impacto.

⚔️ El conflicto entre Anthropic y el Pentágono

Cuando esta colaboración empezó a hacerse visible, surgió un conflicto.

El gobierno estadounidense quería contratos que permitieran usar los modelos de IA para “cualquier uso legal”.

Anthropic se negó.

El CEO de la empresa, Dario Amodei, estableció dos líneas rojas claras:

❌ vigilancia doméstica masiva

❌ armas completamente autónomas

Según fuentes citadas por Reuters, algunos responsables del Pentágono argumentaban que ciertas restricciones contractuales podían poner en riesgo misiones militares.

La tensión escaló rápidamente.

Y el gobierno terminó clasificando a Anthropic como un posible riesgo de cadena de suministro, lo que provocó la retirada de sus herramientas de algunos sistemas.

🤝 OpenAI entra en escena

Tras la ruptura con Anthropic, el Pentágono firmó un acuerdo con OpenAI.

Pero OpenAI también publicó ciertas limitaciones.

Tres “líneas rojas” principales:

🚫 vigilancia doméstica masiva

🚫 control directo de armas autónomas

🚫 decisiones automatizadas de alto riesgo

Además, el despliegue se plantea como cloud-only, es decir, ejecutado en servidores controlados y no directamente en sistemas de armas.

Eso, al menos en teoría, mantiene a la IA en un papel de apoyo.

Aunque muchos expertos señalan que la línea entre asistencia y dependencia puede volverse difusa con el tiempo.

📉 La reacción del mercado

La polémica también tuvo impacto en el mercado de IA.

Los datos más sólidos vienen de firmas de analítica de apps citadas por TechCrunch.

Por ejemplo:

📈 Claude llegó al número 1 del App Store en EE. UU.

Mientras tanto:

📉 Las desinstalaciones de ChatGPT en EE. UU. aumentaron alrededor de un 295 % tras el anuncio del acuerdo con el Pentágono.

Eso sí, hay que tener cuidado con algunas cifras que circulan en redes.

Afirmaciones como “millones de suscriptores perdidos” no están verificadas con datos públicos sólidos.

Lo que sí parece claro es que el debate sobre el uso militar de la IA afectó a la percepción pública de estas empresas.

💡 El verdadero cambio: la guerra algorítmica

Más allá de la polémica empresarial, el cambio real es tecnológico.

La IA generativa está empezando a transformar cómo se toman decisiones militares.

No porque sustituya a los humanos.

Sino porque puede procesar información mucho más rápido que cualquier equipo humano.

El propio análisis plantea tres escenarios posibles:

🟢 Mejor caso: la IA se usa como copiloto analítico con fuerte supervisión humana.

🟡 Escenario intermedio: los humanos siguen revisando decisiones, pero cada vez con menos tiempo.

🔴 Peor caso: la velocidad del sistema termina empujando a confiar demasiado en la IA.

Por ahora, el modelo sigue siendo human-in-the-loop.

Pero el ritmo de la guerra moderna está cambiando.

Y la tecnología puede acelerar ese cambio más de lo que estamos preparados para gestionar.

La historia de la guerra siempre ha estado ligada a nuevas tecnologías.

La pólvora. Los aviones. Las armas nucleares.

Ahora aparece otra: la inteligencia artificial generativa.

Claude ya ha demostrado que puede analizar inteligencia militar, priorizar objetivos y acelerar decisiones estratégicas.

Y eso abre una pregunta enorme.

📢 ¿Quién debería decidir cómo se usa esta tecnología? ¿Los gobiernos? ¿Las empresas tecnológicas? ¿O deberían existir límites internacionales?

Porque una cosa parece clara.

Las guerras del futuro no se decidirán solo con misiles.

También con algoritmos.

🍿 LA BUTACA DEL CAOS

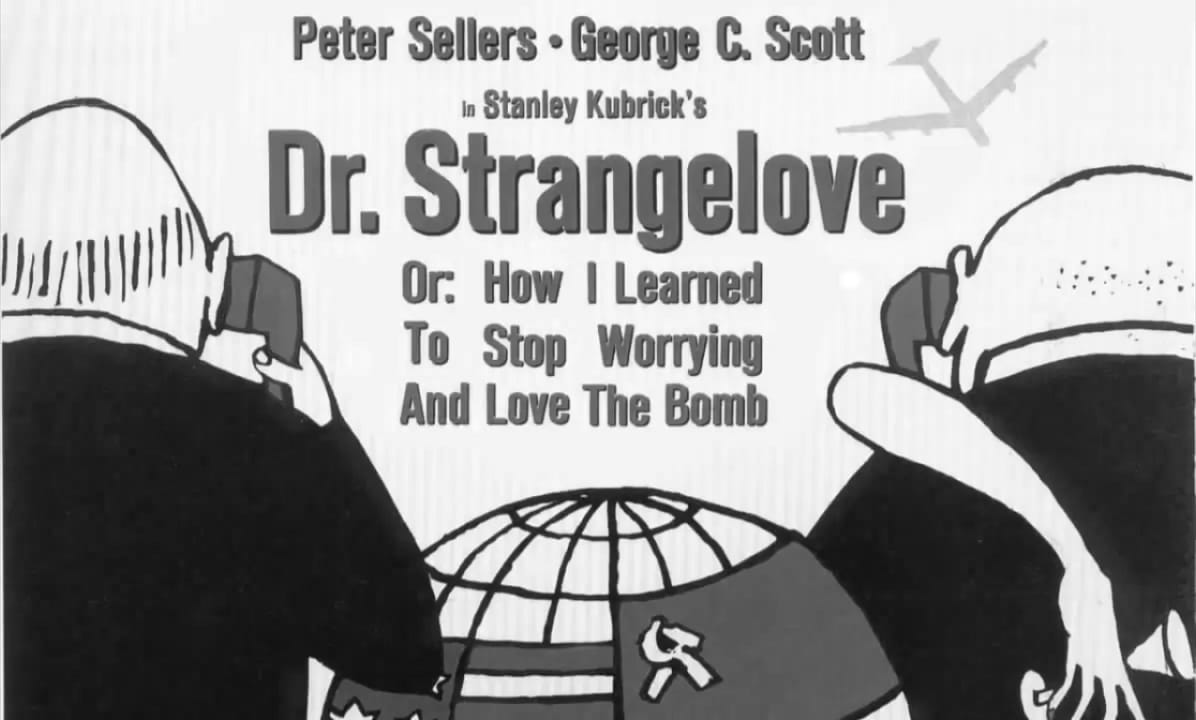

Dr. Strangelove or: How I Learned to Stop Worrying and Love the Bomb (1964)

Dirección: Stanley Kubrick

Dicen que el mundo podría terminar con un estallido… o con una carcajada nerviosa. Kubrick eligió lo segundo. Y lo más perturbador es que, 60 años después, la broma sigue siendo la misma.

En España el título fue modificado parcialmente a “¿Teléfono rojo? Volamos hacia Moscú o: cómo aprendí a dejar de preocuparme y querer la bomba

🎯 Trama:

Un general paranoico convencido de que los soviéticos envenenan los fluidos corporales americanos activa unilateralmente un ataque nuclear. El protocolo funciona perfectamente. Ese es exactamente el problema.

Mientras los bombarderos vuelan hacia el apocalipsis, políticos y militares intentan deshacer lo que sus propios sistemas hicieron posible. Entre ellos, el Dr. Strangelove: científico con pasado nazi y entusiasmo sospechosamente alegre por el fin del mundo.

Hoy llamamos a ese protocolo kill chain. Y le hemos añadido un copiloto que procesa mil objetivos por segundo.

👥 Personajes:

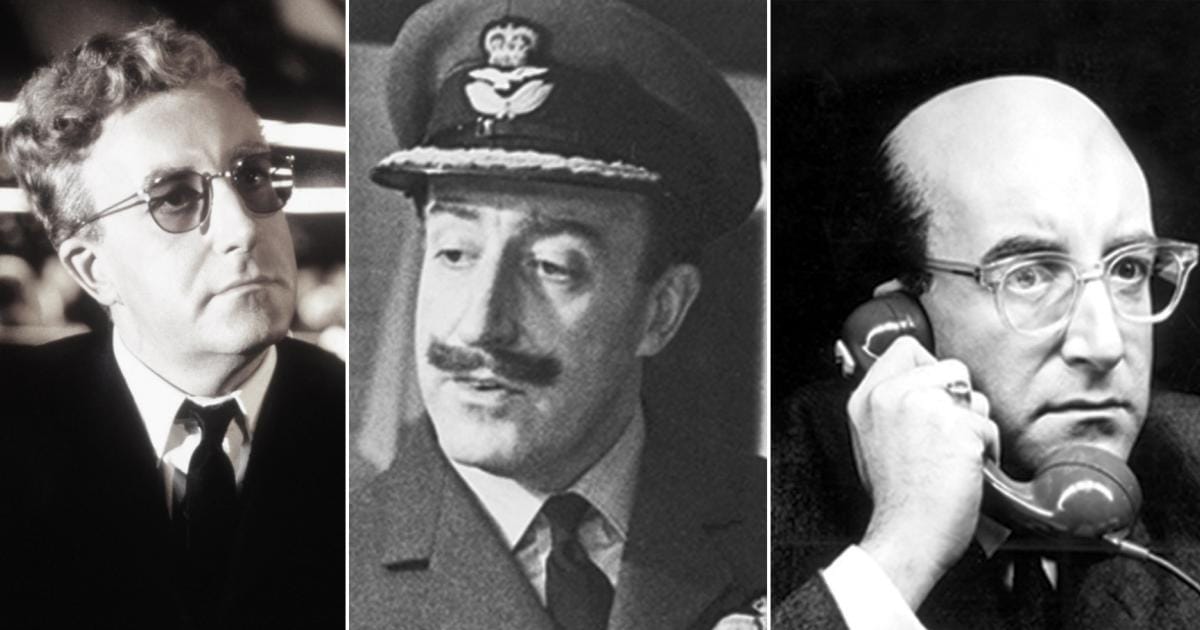

Peter Sellers interpreta tres personajes: el presidente desesperado, el capitán atrapado en la locura militar y el propio Strangelove, mitad genio, mitad caricatura del científico amoral.

Pero quien roba la escena más icónica es Slim Pickens, cabalgando una bomba nuclear como si fuera un rodeo. Tan absurdo que termina siendo aterrador.

Kubrick lo tenía claro: los hombres que deciden el destino del mundo se comportan como niños jugando a la guerra.

🎬 Estilo y narrativa:

Blanco y negro austero, casi documental. La War Room parece un altar donde se adora a la destrucción mutua asegurada. El humor es seco, elegante y venenoso. Cada diálogo es una bala envuelta en sarcasmo.

El humor es seco, elegante y venenoso. No hay chistes fáciles, hay ironía quirúrgica. Cada diálogo es una bala envuelta en sarcasmo. Y mientras el público ríe, algo incómodo ocurre: la risa se convierte en miedo.

🧨 Conclusión:

Hoy Claude analiza inteligencia clasificada, prioriza objetivos y acelera decisiones a velocidades que ningún general de 1964 podría imaginar. Anthropic puso líneas rojas. El Pentágono buscó quien no las pusiera. OpenAI levantó la mano.

Kubrick nos dejó una pregunta sin respuesta: si el destino del planeta depende de gente así, ¿no es lógico que todo termine siendo una gran broma?

La película termina con una bomba y un cowboy cabalgándola con sombrero.

¿Quién decide cómo se usa esta tecnología?

La misma pregunta. Solo que ahora el sombrero de vaquero lo lleva un algoritmo.